우수국제학술대회 The IEEE International Symposium on Cluster, Cloud, and Internet Computing (CCGRID`2026) 정규 발표 논문 채택

데이터 중심 컴퓨팅 및 AI 시스템 연구실 (DISCOS) 석박통합과정 김진우 (제1저자/지도교수 김영재 교수), 김기현 (석박통합), 정현선 (석사과정), 김영재 교수 (교신저자)가 작성한 “LLM-Pilot: SLO-Aware and Cost-Efficient LLM Serving on Public Cloud VM Clusters via Offloading" 논문이 The IEEE International Symposium on Cluster, Cloud, and Internet Computing (CCGrid`2026)에 게재가 확정되었습니다. 올해 총 247편의 논문이 제출되었으며, 이 중 62편이 Long 정규 논문으로 채택되었다 (Acceptance rate는 25.1%).

ChatGPT, Claude, Gemini로 대표되는 대규모 언어 모델(LLM)이 산업 전반으로 확산되면서, 운영 비용 최적화가 핵심 과제로 부상했습니다. 특히 Gemini 3 Pro와 Claude Sonnet 4.5 같은 차세대 모델들이 100만 토큰 이상의 초장문 컨텍스트를 지원하면서, GPU 메모리 부족 문제가 심각한 병목 현상으로 나타나고 있습니다. LLM 추론 과정에서 생성되는 KV 캐시는 시퀀스 길이에 비례해 선형적으로 증가하며, 이는 곧 메모리 비용의 급증으로 이어집니다. 그러나 클라우드 환경의 근본적 제약은 컴퓨팅 성능, 메모리 용량, I/O 대역폭이 사전 패키징된 인스턴스로만 제공되어, 필요한 자원만 독립적으로 확장할 수 없다는 구조적 한계에 있습니다.

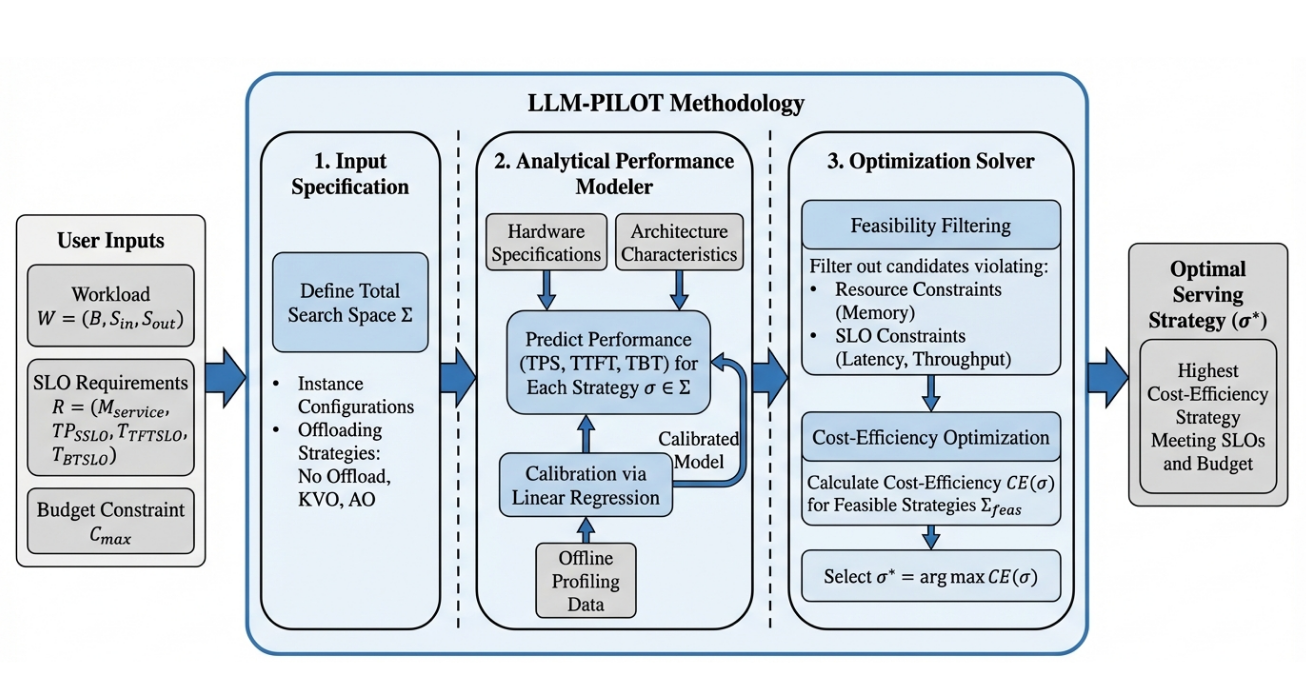

그림 1. LLM-Pilot 방법론 Overview

본 연구팀이 개발한 LLM-PILOT은 이러한 클라우드의 복잡한 다차원 최적화 문제를 체계적으로 해결하는 프레임워크입니다. 시스템은 워크로드 특성(배치 크기, 입출력 시퀀스 길이), 서비스 수준 목표(SLO: 처리량, 지연시간), 예산 제약을 입력받아, 오프로딩 전략과 클라우드 인스턴스 조합을 최적화합니다. 프레임워크의 핵심은 계층적 분석 모델 입니다. LLM 추론을 1. Compute, 2. Memory, 3. Transfer라는 세 가지 하드웨어 독립적 함수로 추상화하고, KV Cache Offloading과 Attention Offloading등 각 오프로딩 전략에 따른 성능 병목을 수학적으로 예측합니다. 나아가 선형 회귀 기반 보정 단계를 통해 실제 하드웨어의 차이를 수학적으로 반영하여 예측 정확도를 더욱 높였습니다.

AWS 실제 운영 환경에서 LLM-Pilot 적용 시, 실시간 서비스에서 고성능 GPU 단독 사용 대비 2.05배 높은 비용 효율성 및 51% 비용 절감을 달성합니다. 배치 서비스에서 기존 최신 연구 대비 2.31배 높은 비용 효율성을 달성합니다. 결정론적 환경에서 평균 절대 백분율 오차(MAPE) 6%이내, 결정계수(R2) 0.89 이상을 달성합니다. 특히 주목할 점은, 기존 방법론들이 엄격한 SLO 조건 하에서 실행 불가능한(infeasible) 구간에서도 LLM-PILOT만이 유일하게 실행 가능한 구성을 찾아냈다는 것입니다. 이는 단순한 성능 개선을 넘어, 실제 서비스 가능 여부 자체를 결정하는 차별화된 가치를 제공합니다.

본 논문의 제1저자인 김진우 석박통합과정은 이번 연구를 통해 LLM 추론 서빙 시스템을 바라보는 관점이 크게 달라졌다고 소감을 밝혔습니다.

그는 “이제는 단순히 비싼 장비가 좋은 것이 아니라, 주어진 요구사항에 정확히 맞는 인프라가 더 중요하다는 것을 느꼈습니다. 무엇을 사용하느냐보다, 왜 그것을 선택했는지가 더 본질적인 문제라는 점을 깨달았습니다.”라고 말했습니다.

또한, 사용자 요구사항과 예산, 워크로드 특성에 따라 최적의 클러스터 구성이 달라진다는 점에서, LLM 서빙은 단순한 시스템 구현이 아니라 경제성과 성능을 동시에 고려하는 설계 문제라는 점이 인상 깊었다고 전했습니다. 특히 클라우드 환경에서는 이러한 선택이 곧 비용과 직결되기 때문에, 수학적 모델링과 예측 기반 의사결정의 중요성을 체감했다고 밝혔습니다.

IEEE CCGRID는 클라우드 컴퓨팅, 분산 시스템, 고성능 컴퓨팅, 인공지능 분야 관련 최신 기술과 실제 적용 사례에 대한 근본적인 발전을 교류하고, 새로운 연구 주제를 발굴하며, 클라우드 컴퓨팅의 미래를 정의하는 것을 목표하는 학회로 올해 행사는 5월 18일부터 21일까지 호주 시드니에서 개최될 예정입니다.

[참고자료]

The 26th IEEE International Symposium on Cluster, Cloud, and Internet Computing (CCGRID`2026)