2025한국소프트웨어종합학술대회 (KSC2025) 학부생 부문 장려상 수상

작성자: 컴퓨터공학과

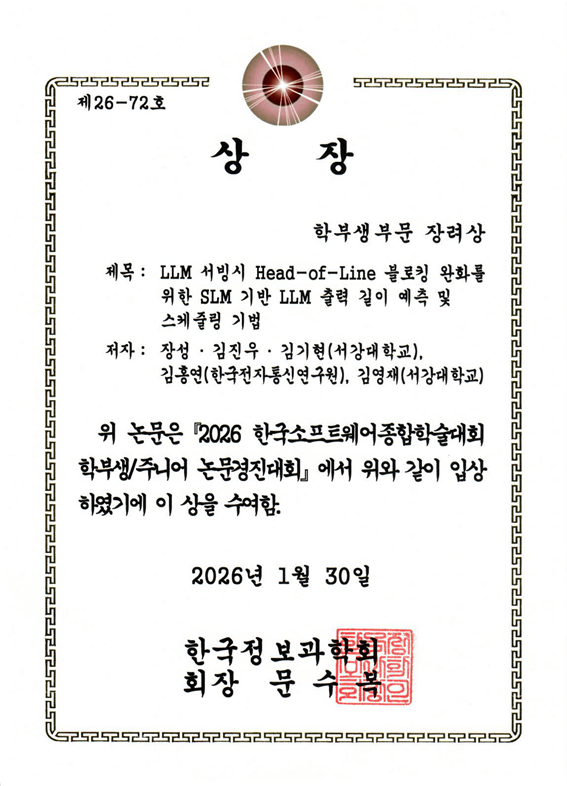

지난 2025년 12월 16일부터 3일간 열린 2025 한국소프트웨어종합학술대회 (KSC2025)에서 컴퓨터공학과 장성 학생(석사 진학 예정, 지도교수: 김영재)의 논문이 학부생/주니어 논문경진대회에서 학부생 부문 장려상을 수상하였다.

대규모 언어 모델(LLM) 서빙 환경에서는 요청별 출력 길이 차이로 인해 HOL(Head-of-Line)블로킹이 발생하며, 이는 전체 처리량 저하의 주요 원인이 된다. 기존QLM은 과거 쿼리 통계 기반으로 출력 길이를 예측하지만, 학습 데이터 분포를 벗어난OOD(Out-of-Distribution) 쿼리에 대해서는 예측 정확도가 낮아 HOL 블로킹을 유발하고 스케줄링 비효율을 초래하는 한계가 있었다.

본 연구에서는 이러한 한계를 극복하기 위해 경량 언어 모델(SLM)을 활용해OOD 쿼리의 출력 길이를 실시간으로 예측하고, 이를 스케줄링 우선순위에 반영하는S-QLM 기법을 제안하였다. ShareGPT 데이터셋 기반 실험 결과, 기존 방식 대비 최대11.5%의 처리량 향상을 달성하며LLM 서빙 환경에서의 효율성과 안정성을 개선함을 입증하였다.